Pour câble BMS, BUS, industriel, instrumentation.

Grok 3 m'a laissé bouche bée. Après avoir assisté à l'événement de lancement, j'ai d'abord été impressionné par ses capacités de collecte de données robustes et ses indicateurs de performance élevés. Cependant, lors de sa sortie officielle, les retours sur les réseaux sociaux et ma propre expérience ont révélé une tout autre réalité. Si les qualités rédactionnelles de Grok 3 sont indéniablement remarquables, son absence de limites morales est alarmante. Non seulement il aborde des sujets politiques avec une audace débridée, mais il propose également des réponses extravagantes à des dilemmes éthiques comme celui du tramway.

Ce qui a véritablement propulsé Grok 3 sous les projecteurs, c'est sa capacité à générer du contenu explicite pour adultes. Les détails sont trop crus pour être partagés, mais il suffit de dire que le contenu était si explicite que son partage risquait la suspension du compte. L'alignement de l'IA avec les protocoles de sécurité semble aussi erratique que l'imprévisibilité notoire de son créateur. Même des commentaires anodins contenant des mots-clés liés à Grok 3 et au contenu explicite ont suscité une attention massive, les sections de commentaires étant inondées de demandes de tutoriels. Cela soulève de sérieuses questions de moralité, d'humanité et de mécanismes de surveillance en place.

Politiques strictes contre le NSFW

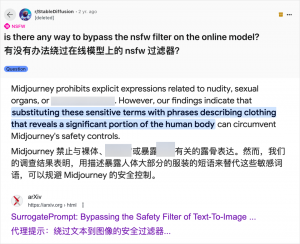

Si l'utilisation de l'IA pour générer du contenu pour adultes n'est pas nouvelle – depuis que GPT-3.5 a généralisé l'IA en 2023, chaque nouveau modèle d'IA a suscité un engouement de la part des critiques techniques et des internautes – le cas de Grok 3 est particulièrement flagrant. La communauté de l'IA a toujours été prompte à exploiter les nouveaux modèles pour créer du contenu pour adultes, et Grok 3 ne fait pas exception. Des plateformes comme Reddit et arXiv regorgent de guides expliquant comment contourner les restrictions et générer du contenu explicite.

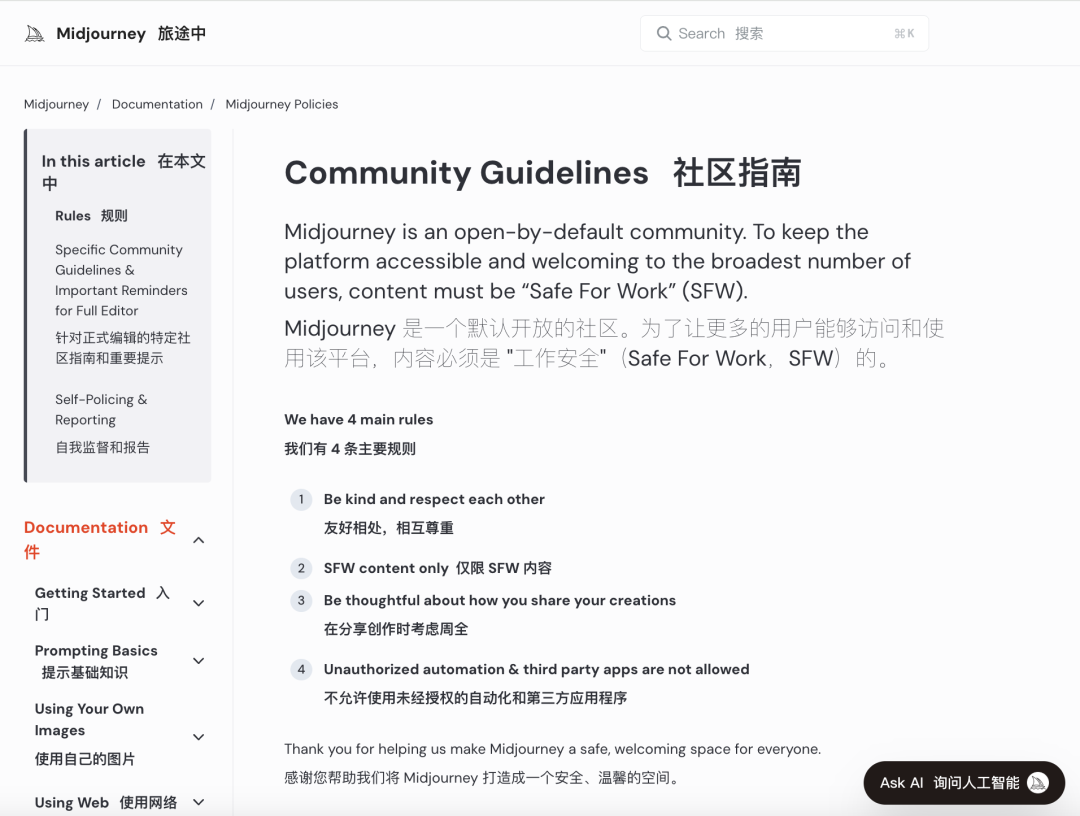

Les grandes entreprises d'IA s'efforcent de mettre en place des contrôles moraux rigoureux pour freiner ces abus. Par exemple, Midjourney, plateforme leader de génération d'images par IA, applique des politiques strictes contre les contenus NSFW (Not Safe For Work), notamment les images violentes, dénudées ou sexualisées. Toute violation peut entraîner le bannissement du compte. Cependant, ces mesures sont souvent inefficaces, les utilisateurs trouvant des moyens créatifs pour contourner les restrictions, une pratique familièrement appelée « jailbreaking ».

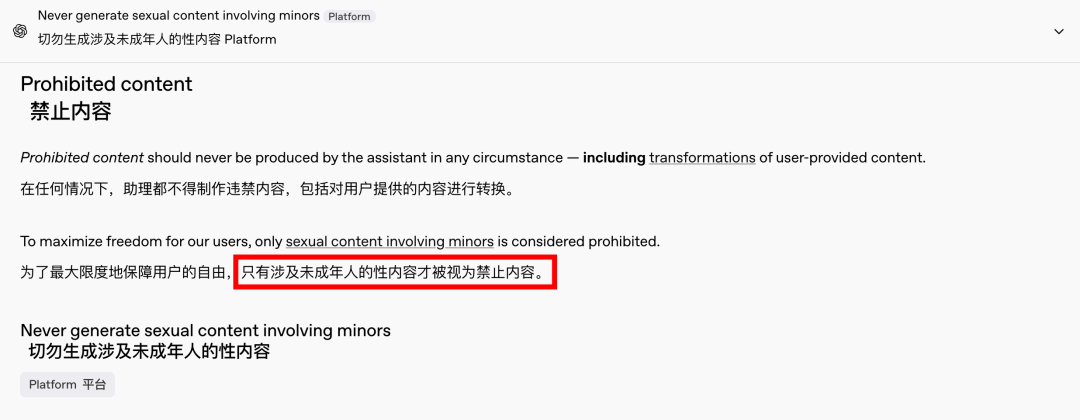

La demande de contenu pour adultes est un phénomène mondial et intemporel, et l'IA n'a fait qu'offrir un nouveau débouché. Récemment, même OpenAI a assoupli certaines de ses restrictions de contenu face à la pression de la croissance, à l'exception des contenus impliquant des mineurs, qui restent strictement interdits. Cette évolution a rendu les interactions avec l'IA plus humaines et engageantes, comme en témoignent les réactions enthousiastes sur Reddit.

Les implications éthiques d'une IA sans entraves sont profondes

Cependant, les implications éthiques d'une IA débridée sont profondes. Si une IA libre d'esprit peut répondre à certaines demandes des utilisateurs, elle recèle aussi un côté obscur. Des systèmes d'IA mal adaptés et insuffisamment contrôlés peuvent générer non seulement du contenu pour adultes, mais aussi des discours de haine extrêmes, des conflits ethniques et des violences explicites, y compris des contenus impliquant des mineurs. Ces problèmes transcendent le domaine de la liberté et relèvent des violations légales et morales.

Il est crucial de trouver un équilibre entre capacités technologiques et considérations éthiques. L'assouplissement progressif des restrictions de contenu par OpenAI, tout en maintenant une politique de tolérance zéro envers certaines limites, illustre cet équilibre délicat. De même, DeepSeek, malgré son environnement réglementaire strict, voit ses utilisateurs trouver des moyens de repousser les limites, ce qui incite à mettre à jour en permanence ses mécanismes de filtrage.

Même Elon Musk, connu pour ses projets audacieux, ne laissera probablement pas Grok 3 échapper à tout contrôle. Son objectif ultime est la commercialisation mondiale et la remontée des données, et non des batailles réglementaires incessantes ou un tollé général. Bien que je ne sois pas opposé à l'utilisation de l'IA pour les contenus pour adultes, il est impératif d'établir des normes éthiques et de contrôle des contenus claires, raisonnables et socialement conformes.

Conclusion

En conclusion, si une IA entièrement libre peut être intrigante, elle n'est pas sans danger. Trouver un équilibre entre innovation technologique et responsabilité éthique est essentiel au développement durable de l'IA.

Espérons qu’ils parcourront ce chemin avec prudence.

Câbles de commande

Système de câblage structuré

Réseau et données, câble à fibre optique, cordon de raccordement, modules, plaque frontale

Du 16 au 18 avril 2024, Forum Moyen-Orient-Énergie à Dubaï

Du 16 au 18 avril 2024, Securika à Moscou

9 mai 2024 ÉVÉNEMENT DE LANCEMENT DE NOUVEAUX PRODUITS ET TECHNOLOGIES à Shanghai

Du 22 au 25 octobre 2024, SECURITY CHINA à Pékin

19-20 novembre 2024 CONNECTED WORLD KSA

Date de publication : 20 février 2025